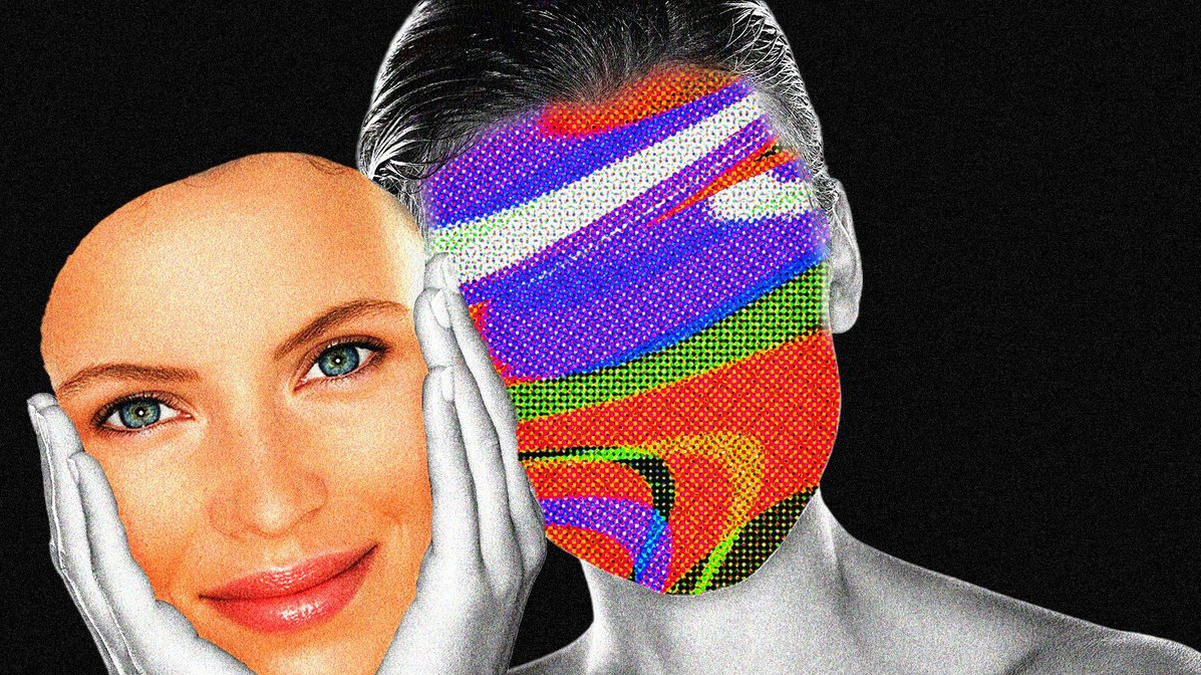

ЭКСКЛЮЗИВ: ЖИВЫЕ ЛИЦА ДЛЯ МЕРТВЫХ ДУШ. КАК НАБИРАЮТ «МОДЕЛЕЙ» ДЛЯ МАСШТАБНЫХ AI-МОШЕННИЧЕСТВ

Мир кибербезопасности столкнулся с новой, шокирующей реальностью: промышленные мошеннические синдикаты в Камбодже и Юго-Восточной Азии массово нанимают так называемых «AI-фейс-моделей». Их задача — оживлять глубокие фейки в видеозвонках, чтобы выманивать миллионы. Это не просто вредоносное ПО, это живой человек как конечный эксплойт.

Десятки каналов в Telegram пестрят вакансиями для «моделей реального лица». Кандидаты, в основном молодые женщины из Узбекистана, Турции, России и Украины, присылают видео-резюме, хвастаясь знанием языков. Их данные — рост, вес, мимика — становятся цифровым сырьем. Одна такая «модель» с позывным Анжел уже имеет «год опыта работы AI-моделью». Ее языковые навыки теперь инструмент для изощренных схем «свиноводства» (pig-butchering).

«За последний год они активно нанимают людей на роль AI-моделей, — заявляет эксперт по киберпреступности из некоммерческой организации ChongLuaDao. — Они предоставляют софт для подмены лица в реальном времени через AI. Это следующий уровень социальной инженерии, где фишинг обретает живой, дышащий образ». Эти криминальные предприятия, связанные с торговлей людьми, используют «моделей» для романтических и инвестиционных афер с крипто, создавая иллюзию абсолютного доверия.

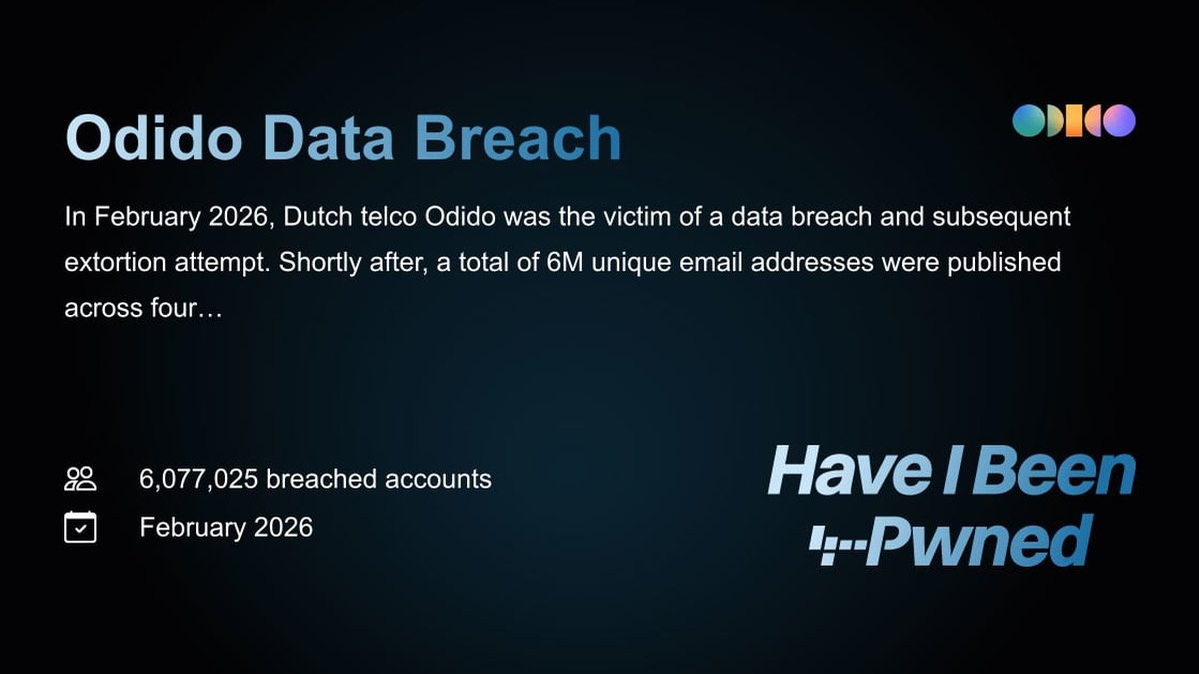

Почему это касается каждого? Потому что следующей жертвой видеозвонка с «успешным трейдером» или симпатичным незнакомцем можете стать вы или ваши близкие. Утечка данных здесь — это утечка человеческого облика. Безопасность блокчейна бессильна, когда доверие взламывают через эмоции.

Ожидайте лавину таких атак по всему миру. Злоумышленники коммерциализируют 0-day уязвимость в человеческой психологии, а не в коде.

Когда мошенник смотрит на вас глазами живого человека, даже самая продвинутая защита может дать сбой.